Le 2 avril 2026, Google DeepMind a publié quelque chose qui mérite votre attention, même si vous n’êtes pas développeur. Gemma 4 est une famille de modèles d’intelligence artificielle ouverts, gratuits, multimodaux et commercialement libres d’utilisation. En clair : n’importe qui peut les télécharger, les modifier, les intégrer dans un produit payant et les redistribuer sans demander la permission à Google. Cette réalité, dans un secteur où les modèles les plus puissants restent enfermés derrière des API payantes et des conditions d’utilisation restrictives, représente un changement de paradigme concret.

Ce n’est pas une annonce de plus dans le flux ininterrompu des sorties de modèles IA. C’est une décision stratégique qui repose Google dans la course à l’intelligence artificielle ouverte, et qui change les règles du jeu pour les développeurs, les entreprises et, indirectement, pour vous.

Ce que Gemma 4 est vraiment

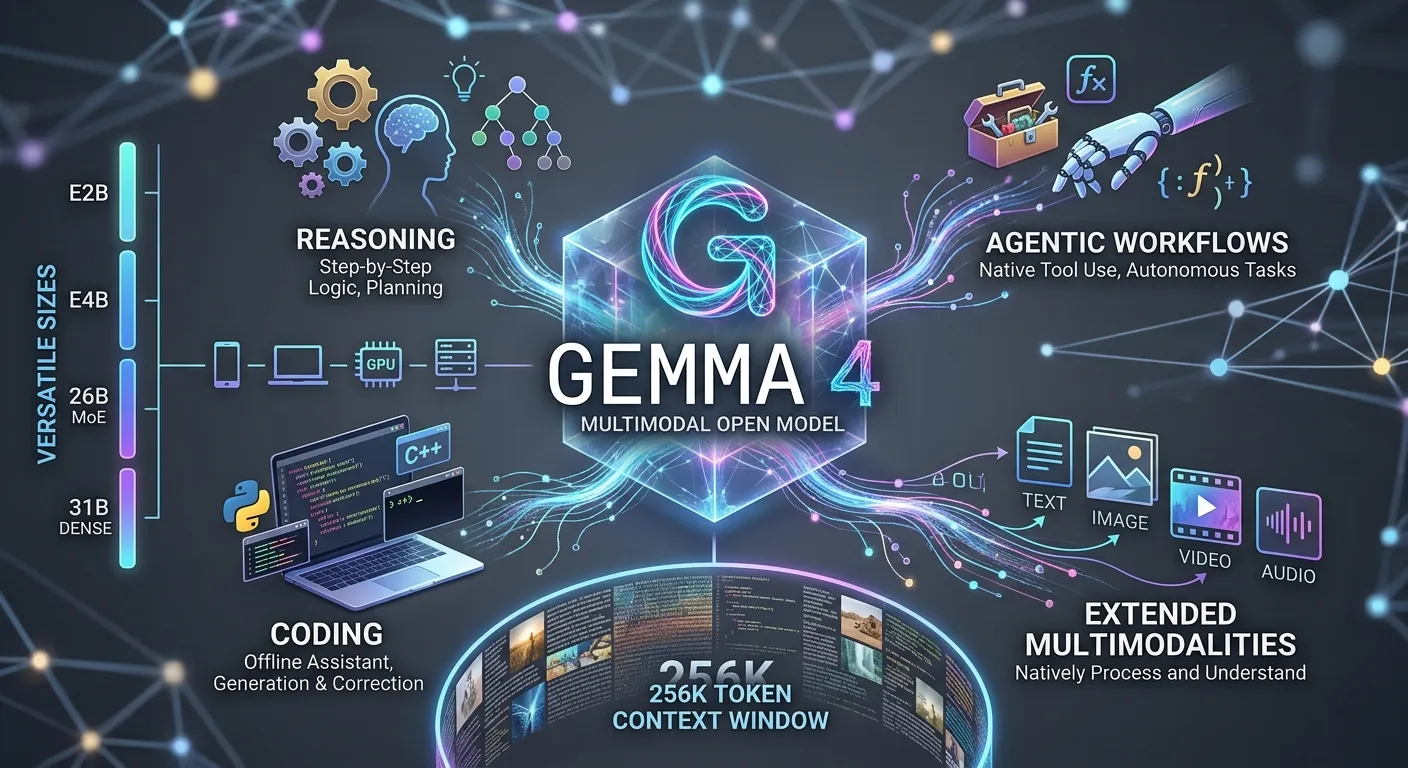

Gemma 4 n’est pas un modèle unique. C’est une famille de quatre modèles aux tailles et aux usages distincts. Le modèle E2B, ou Effective 2 Billion, et le modèle E4B sont conçus pour fonctionner directement sur des appareils mobiles, des Raspberry Pi ou des ordinateurs portables grand public. Les modèles 26B en architecture Mixture of Experts et 31B Dense, eux, sont destinés à des déploiements professionnels sur GPU ou dans le cloud.

Ce que cette diversité de tailles signifie pour vous, c’est que Gemma 4 ne vise pas un seul type d’utilisateur. Il vise tous les profils, du développeur indépendant qui veut faire tourner un modèle localement sans connexion internet, jusqu’à la grande entreprise qui déploie de l’IA sur des infrastructures cloud souveraines avec des garanties de conformité strictes.

Selon la documentation officielle de Google DeepMind, Gemma 4 supporte des fenêtres de contexte allant jusqu’à 256 000 tokens pour les modèles 26B et 31B. Pour vous donner un ordre de grandeur, cela représente environ 200 000 mots de texte traités en une seule fois. C’est considérable. Cela permet d’analyser des documents longs, des bases de code entières ou des transcriptions complètes sans perdre le fil du raisonnement.

Gemma 4 et la licence Apache 2.0 : pourquoi c’est plus important qu’il n’y paraît

La licence sous laquelle un modèle est publié est souvent perçue comme un détail technique. Ce n’en est pas un. C’est l’une des décisions les plus structurantes que puisse prendre un laboratoire d’IA.

Gemma 4 est publié sous licence Apache 2.0. Concrètement, cela signifie que vous pouvez utiliser ces modèles dans un produit commercial sans payer de redevances, les modifier librement, les redistribuer et les intégrer dans vos propres services. La seule obligation est de conserver la notice de copyright originale si vous distribuez le modèle.

Comparez cela aux modèles Llama de Meta, qui imposent des restrictions d’usage commercial au-delà de certains seuils d’utilisateurs actifs mensuels, ou aux modèles propriétaires d’OpenAI et d’Anthropic, accessibles uniquement via des API facturées à l’usage. Gemma 4 supprime ces barrières. Pour une startup qui cherche à construire un produit IA sans dépendre d’un fournisseur externe ni s’exposer à des coûts variables imprévisibles, cette liberté a une valeur économique réelle et immédiate.

Multimodalité native : voir, entendre, lire et raisonner

L’une des ruptures techniques les plus significatives de Gemma 4 par rapport aux générations précédentes est sa multimodalité native. Les versions antérieures de Gemma étaient exclusivement textuelles. Gemma 4 traite nativement le texte, les images, la vidéo et, pour les modèles E2B et E4B, l’audio.

Ce n’est pas une fonctionnalité ajoutée en surface. Selon la documentation technique de Google AI, la vision et le traitement audio sont intégrés directement dans les poids du modèle, et non greffés via un pipeline externe. Cette différence architecturale a des conséquences pratiques importantes : les performances sur les tâches multimodales sont plus cohérentes, la latence est réduite et le comportement du modèle est plus prévisible.

Concrètement, Gemma 4 peut analyser des documents PDF, lire des captures d’écran d’interfaces, reconnaître du texte manuscrit, comprendre des graphiques, détecter des objets dans des images et résumer des vidéos en traitant des séquences d’images. Pour un développeur qui construit une application d’assistance documentaire, un outil de veille visuelle ou un agent autonome, ces capacités changent ce qui est faisable sans recourir à des services externes spécialisés.

Gemma 4 et le raisonnement pas à pas

L’une des avancées les moins visibles mais les plus significatives de Gemma 4 est son mode de raisonnement intégré, souvent appelé « thinking mode » dans la documentation anglophone. Ce mode permet au modèle de produire une chaîne de raisonnement intermédiaire avant de formuler sa réponse finale.

Cette approche, inspirée des travaux sur le chain-of-thought prompting publiés notamment par Wei et al. dans leur article de 2022 dans les actes de NeurIPS, améliore significativement les performances sur les tâches complexes de logique, de mathématiques et de planification multi-étapes. La différence observable pour vous, en tant qu’utilisateur ou développeur, c’est un modèle qui fait moins d’erreurs sur les problèmes qui nécessitent plusieurs étapes de réflexion, et qui peut expliquer son raisonnement de façon transparente.

Gemma 4 sur votre téléphone : l’IA offline devient réalité

L’un des aspects les plus frappants de cette sortie est la capacité de Gemma 4 à fonctionner entièrement hors connexion sur des appareils mobiles courants. Les modèles E2B et E4B nécessitent respectivement un minimum de 4 Go de RAM pour fonctionner, ce qui correspond à la configuration de la plupart des smartphones modernes.

Google a annoncé une préversion développeur d’AICore, un système intégré à Android qui permet aux applications d’accéder à Gemma 4 directement depuis le système d’exploitation, sans passer par internet. Les développeurs Android peuvent dès aujourd’hui prototyper des flux agentiques avec cette infrastructure et préparer des applications compatibles avec les futurs appareils équipés de Gemini Nano 4.

Pour vous, cela signifie concrètement qu’une application d’assistance personnelle, de traduction, d’analyse documentaire ou de génération de contenu pourra bientôt fonctionner sur votre téléphone sans envoyer vos données vers un serveur externe. La confidentialité devient une caractéristique structurelle, et non plus un argument marketing.

Ce que Gemma 4 change pour les entreprises

Les organisations qui traitent des données sensibles ont longtemps été confrontées à un dilemme difficile. Soit elles acceptent d’envoyer leurs données vers des API cloud tierces avec tous les risques de conformité que cela implique, soit elles renoncent aux modèles les plus performants faute de pouvoir les déployer dans leur propre infrastructure.

Gemma 4 change cette équation. Selon le blog officiel de Google Cloud, le modèle est disponible sur Vertex AI avec des garanties de conformité incluant des solutions de cloud souverain. Les entreprises peuvent déployer Gemma 4 dans leur propre environnement Google Cloud, contrôler intégralement leurs données et bénéficier des capacités de fine-tuning sur leurs propres corpus métiers via Vertex AI Training Clusters.

La fonction calling native de Gemma 4, c’est-à-dire sa capacité à invoquer des outils externes de façon structurée, permet de construire des agents IA capables d’interagir avec des systèmes internes, des bases de données ou des API métiers sans dépendance à un fournisseur extérieur. C’est un changement structurel dans la façon dont les entreprises peuvent envisager l’automatisation intelligente de leurs processus.

Gemma 4 face à ses concurrents : une honnêteté nécessaire

Il serait inexact de présenter Gemma 4 comme un modèle sans limites. Sur certains benchmarks de raisonnement et de génération de code, les modèles propriétaires d’OpenAI et d’Anthropic conservent des avantages mesurables. La version 31B Dense de Gemma 4 a atteint la troisième place sur le classement Arena.ai au moment de sa sortie, ce qui est remarquable pour un modèle open source de cette taille, mais ne signifie pas qu’il surpasse systématiquement GPT-4o ou Claude 3.7 sur toutes les tâches.

Ce n’est cependant pas la bonne façon de poser la question. La vraie comparaison pertinente n’est pas « Gemma 4 est-il meilleur que GPT-4o ? » mais « Gemma 4 offre-t-il un niveau de performance suffisant pour votre cas d’usage, avec une liberté d’utilisation et une maîtrise des données que GPT-4o ne peut pas vous offrir ? » Pour un grand nombre de cas d’usage réels, la réponse est oui.

Ce que les 400 millions de téléchargements disent de l’écosystème Gemma

Depuis le lancement de la première version de Gemma en février 2024, les modèles de la famille ont été téléchargés plus de 400 millions de fois selon Google DeepMind. Plus de 100 000 variantes ont été créées par la communauté et publiées sur des plateformes comme Hugging Face. Ce chiffre n’est pas anecdotique. Il témoigne d’un écosystème vivant, d’une adoption réelle par des développeurs qui construisent des choses concrètes avec ces modèles.

Gemma 4 arrive dans cet écosystème avec un support natif dès le premier jour pour Hugging Face Transformers, llama.cpp, Ollama, vLLM, MLX, LM Studio et une dizaine d’autres outils que les développeurs utilisent quotidiennement. Vous n’avez pas à attendre des semaines que la communauté adapte le modèle à vos outils préférés. Il fonctionne immédiatement dans les environnements que vous connaissez déjà.

Ce que cela signifie pour la suite

Google ne publie pas Gemma 4 par altruisme. C’est une décision stratégique qui vise à ancrer son infrastructure cloud, ses outils de développement et son écosystème Android au centre de la prochaine vague d’applications IA. Mais les motivations d’une entreprise et la valeur qu’elle crée pour ses utilisateurs ne s’excluent pas mutuellement.

Ce que Gemma 4 représente concrètement, c’est un moment où la frontière entre l’IA accessible et l’IA de pointe s’est encore réduite. Les capacités qui étaient réservées aux grandes organisations dotées de budgets API conséquents sont désormais disponibles pour quiconque dispose d’un ordinateur, d’une connexion internet et de curiosité.

Vous n’avez pas besoin d’être ingénieur chez Google pour utiliser ce que Google a construit. C’est peut-être là le changement le plus profond que Gemma 4 introduit.